Поиск по тегу «neural networks» в разделе Видеокаталог

HD 00:05:03

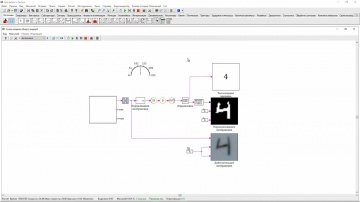

АСУ ТП: Распознавание образа с видеопотока от камеры в SimInTech - видео

На видео демонстрируется распознавание образа при помощи нейросети с видеопотока от камеры в SimInTech. Сделано в #SimInTech #моделирование #системы управления #САУ #АСУТП #встраиваемое_ПО #Сделано_в_России

Cмотреть видео

Cмотреть видео

HD 00:15:36

Python: LSTM - долгая краткосрочная память | #23 нейросети на Python - видео

Как работает рекуррентный блок LSTM (Long short-term memory). Подробное объяснение LSTM-ячейки. Авторы: Зепп Хохрайтер и Юрген Шмидхубер (Jürgen Schmidhuber).

Cмотреть видео

Cмотреть видео

HD 00:18:35

Python: Делаем прогноз слов рекуррентной сетью. Embedding слой | #21 нейросети на Python - видео

Как можно создать сеть для прогнозирования последующих слов текста? Пример реализации в пакете Keras. Рассказывается о сопосбе представления слов в обучающей выборке, о парсинге текста с помощью инструмента Tokenizer, методы: fit_on_texts, ...

Cмотреть видео

Cмотреть видео

HD 00:12:56

Python: Теория стилизации изображений (Neural Style Transfer) | #16 нейросети на Python - видео

Как выполняется перенос стиля с одного изображения на другое. Вы узнаете концепцию общего алгоритма, способ вычисления критерия качества для оценки контента и степени стилизации с помощью сверточной нейронной сети VGG19.

Cмотреть видео

Cмотреть видео

HD 00:15:26

Python: Делаем сверточную нейронную сеть в Keras | #14 нейросети на Python - видео

Смотрите как сделать сверточную нейронную сеть в пакете Keras для распознавания рукописных цифр. Рассматриваются слои: Conv2D, MaxPooling2D. Также в Keras имеются аналогичные слои Conv1D, Conv2D и Conv3D. Сверточные слои: https://ru-k...

Cмотреть видео

Cмотреть видео

HD 00:11:53

Python: Batch Normalization (батч-нормализация) что это такое? | #12 нейросети на Python - видео

Зачем нужна батч-нормализация (Batch Normalization), как работает и как ее реализовать в пакете Keras. Также вы узнаете что такое ковариационный сдвиг и внутренний ковариационный сдвиг в нейронной сети. К чему это приводит и как с ним борот...

Cмотреть видео

Cмотреть видео

HD 00:12:03

Python: Оптимизаторы в Keras, формирование выборки валидации | #10 нейросети на Python - видео

Вы узнаете как использовать оптимизаторы градиентного спуска пакета Keras, какие они существуют. Увидите способы разбиения обучающего множества на выборки валидации и собственно обучения. Офф. док. Keras: https://keras.io/api/optimizers/ad...

Cмотреть видео

Cмотреть видео

HD 00:06:12

Java: Самые Перспективные Сферы Программирования И Как В Них Ворваться - видео

Профессия программиста крута своей свободой выбора. Технологии развиваются просто с бешеной скоростью и проникают абсолютно во все сферы человеческой жизни, начиная от развлечения и финансов, заканчивая космическими ракетами. Выбор огром...

Cмотреть видео

Cмотреть видео

HD 00:19:13

Python: Функции активации, критерии качества работы НС | #6 нейросети на Python - видео

Рекомендации по выбору функций активации для сетей с малым и большим числом слоев, а также для решения задач линейной регрессии и классификации. Рассматриваются функции: гиперболический тангенс, сигмоида, ReLu, softmax, linear. Рекомендации...

Cмотреть видео

Cмотреть видео

HD 00:13:28

Python: Ускорение обучения, начальные веса, стандартизация, подготовка выборки | #4 нейросети на Pyt

Способы ускорения работы градиентного спуска при обучении нейронных сетей. Инициализация начальных значений весовых коэффициентов и bias. Стандартизация входных данных обучающей выборки. Порядок подачи наблюдений из выборки при обучении ней...

Cмотреть видео

Cмотреть видео

HD 00:19:46

Python: Персептрон - возможности классификации образов, задача XOR | #2 нейросети на Python - видео

Классификация линейно-разделимых образов с помощью персептрона на одном нейроне. Понятие биаса (bias) - порогового смещения. Различение нелинейно-разделимых образов (задача XOR) с помощью трехслойной нейронной сети. lesson 2_1.py, lesson ...

Cмотреть видео

Cмотреть видео

HD 00:14:29

Python: Структура и принцип работы полносвязных нейронных сетей | #1 нейросети на Python - видео

Структура нейронных сетей, полносвязные нейронные сети прямого распространение. Входной слой, скрытые слои, выходной слой. Принцип работы нейрона. Пороговая функция активации. lesson 1.py: https://github.com/selfedu-rus/neural-network

Cмотреть видео

Cмотреть видео

HD 01:07:50

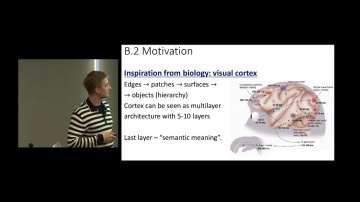

DNN/SNN | Лекция 6: Глубокие нейронные сети

Автор: Максим Кретов Доклад Максима Кретова "Глубокие нейронные сети" был озвучен в 2016 году в рамках курса "Cовременные подходы в машинном обучении: применение нейронных сетей, введение в обучение с подкреплением и глубокое обучение". ...

Cмотреть видео

Cмотреть видео

HD 01:03:05

DNN/SNN | Лекция 5: Практика по обучению нейронных сетей

Автор: Максим Кретов Доклад Максима Кретова "Улучшение сходимости алгоритма обучения нейронных сетей" был озвучен в 2016 году в рамках курса "Cовременные подходы в машинном обучении: применение нейронных сетей, введение в обучение с подкре...

Cмотреть видео

Cмотреть видео

HD 01:23:38

DNN/SNN | Лекция 4: Улучшение сходимости алгоритма обучения нейронных сетей

Автор: Максим Кретов Доклад Максима Кретова "Улучшение сходимости алгоритма обучения нейронных сетей" был озвучен в 2016 году в рамках курса "Cовременные подходы в машинном обучении: применение нейронных сетей, введение в обучение с подкре...

Cмотреть видео

Cмотреть видео

HD 01:45:45

DNN/SNN | Лекция 1: От перцептрона до глубоких нейронных сетей

Автор: Михаил Бурцев Доклад Михаила Бурцева "Основные понятия машинного обучения" был озвучен в 2016 году в рамках курса "Cовременные подходы в машинном обучении: применение нейронных сетей, введение в обучение с подкреплением и глубокое о...

Cмотреть видео

Cмотреть видео

HD 01:12:29

DNN/SNN | Лекция 3: Обучение методом обратного распространения ошибки

Автор: Максим Кретов Доклад Максима Кретова "Обучение методом обратного распространения ошибки" был озвучен в 2016 году в рамках "Cовременные подходы в машинном обучении: применение нейронных сетей, введение в обучение с подкреплением и гл...

Cмотреть видео

Cмотреть видео

HD 01:29:30

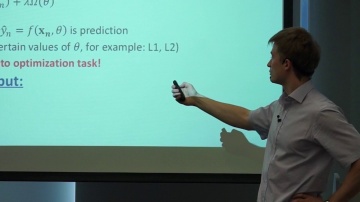

DNN/SNN | Лекция 2: Основные понятия машинного обучения

Автор: Максим Кретов Доклад Максима Кретова "Основные понятия машинного обучения" был озвучен в 2016 году в рамках курса "Cовременные подходы в машинном обучении: применение нейронных сетей, введение в обучение с подкреплением и глубокое о...

Cмотреть видео

Cмотреть видео